微软在其安全工具箱中增加了另一种由人工智能驱动的装备,今天宣布微软安全领航员(Security Copilot)处于内部预览阶段。旨在让安全专业人员”看到他们环境中正在发生的事情,从现有的情报中学习,关联威胁活动,并以机器的速度做出更明智、高效的决定”。

据微软描述,Security Copilot在Azure的超大规模架构上运行,它将OpenAI的GPT4提供的大语言模型与微软建立的安全特定模型相结合,以提供”企业级的安全和符合隐私的体验”。

Google Ads

这些广告安全、信息丰富且有趣。请考虑关闭该网站的广告拦截器,些许广告收入有助于维持网站的活力,谢谢

请关闭广告拦截器

这些广告安全、信息丰富且有趣。请考虑关闭该网站的广告拦截器,些许广告收入有助于维持网站的活力,谢谢

请关闭广告拦截器

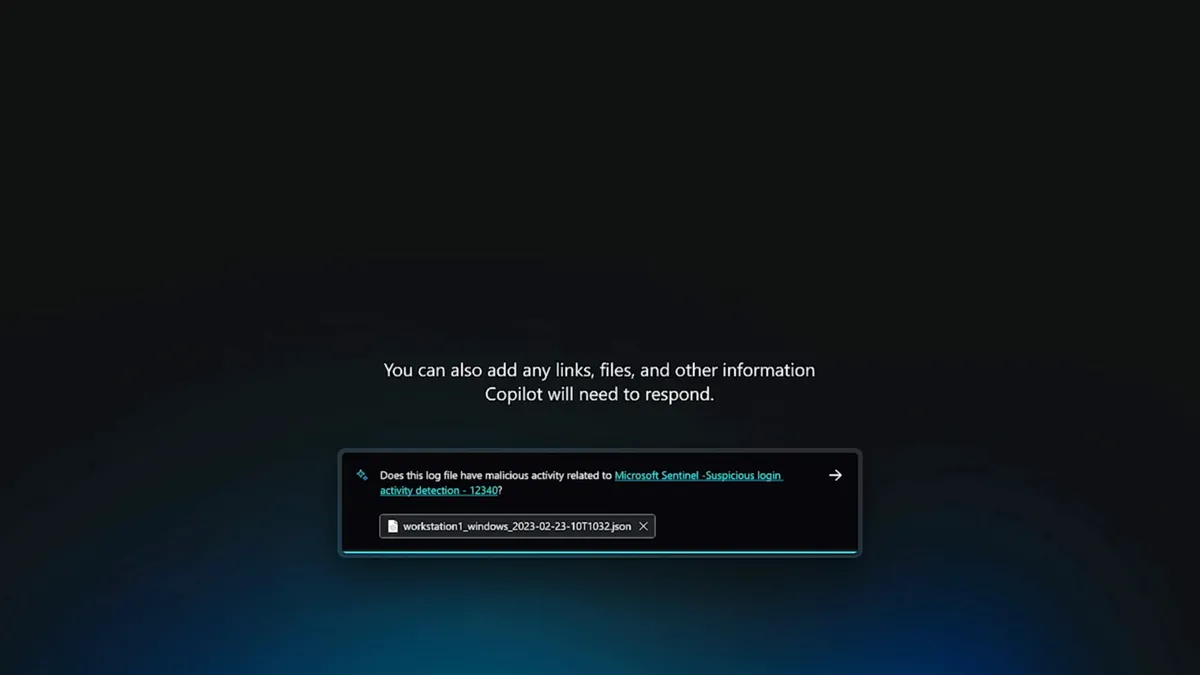

当Security Copilot收到安全专业人员的提示时,它就会利用安全专用模型的全部力量来部署技能和查询,从而最大限度地发挥最新大型语言模型能力的价值。而这对于一个安全用例来说是独一无二的,新的网络训练模型增加了一个学习系统来创建和调整新的技能。然后,Security Copilot可以帮助捕捉其他方法可能错过的东西,并增强分析员的工作。在一个典型的事件中,这种提升可以转化为检测质量、响应速度和加强安全态势的能力方面的收益。

安全领航员并不总是能做对所有事情,AI生成的策略可能包含纰漏甚至错误。但Security Copilot是一个闭环学习系统,这意味着它在不断地向用户学习,并通过直接内置在工具中的反馈功能给他们提供明确的反馈。随着我们不断从这些互动中学习,我们正在调整它的反应,以创造更连贯、相关和有用的答案。

Security Copilot将与微软的安全产品整合,并随着时间的推移,将扩展到包括”一个不断增长的生态系统”的第三方产品。

你可以在Introducing Microsoft Security Copilot网站上了解更多关于Microsoft Security Copilot的信息并观看演示:

© 版权声明

本站所有文章,仅代表文章作者个人观点,如对观点有疑义时不用怀疑,您绝对是对的。

您也可以联系文章作者本人进行修改,若内容侵权或非法,可以联系我们进行处理。

任何个人或组织,转载、发布本站文章到任何网站、书籍等各类媒体平台,必须在文末署名文章出处并链接到本站相应文章的URL地址。

本站文章如转载自其他网站,会在文末署名原文出处及原文URL的跳转链接,如有遗漏,烦请告知修正。

如若本站文章侵犯了原著者的合法权益,亦可联系我们进行处理。

您也可以联系文章作者本人进行修改,若内容侵权或非法,可以联系我们进行处理。

任何个人或组织,转载、发布本站文章到任何网站、书籍等各类媒体平台,必须在文末署名文章出处并链接到本站相应文章的URL地址。

本站文章如转载自其他网站,会在文末署名原文出处及原文URL的跳转链接,如有遗漏,烦请告知修正。

如若本站文章侵犯了原著者的合法权益,亦可联系我们进行处理。

THE END

hi9个月前0

请问有详细一点的自己搭建的教程吗你好10个月前0

你好,可以再帮我看看吗? 我已经按照你的方法设定了,还是一样,wordpress后台的 Purge Varnish Cache 插件还是清除不到cache,依旧显示 the varnish control terminal is not responding at。谢谢 https://mjj.today/i/Srk2Tz https://mjj.today/i/Srkcoi你好10个月前0

对,你说的没错,我配置的时候改了一些东西,现在我按照你的教学,可以启动了,网页可以缓存了,不过wordpress 清除cache 那个插件没用的,我输入本地回环地址127.0.0.1 :6082 ,再输入API key ,插件显示the varnish control terminal is not responding at 127.0.0.1:6082,就你图片那样,然后试一下点击清除cache 那里,他显示error,研究了一天,还是没有不行。你好10个月前1

你好,为啥我按照你的方法,到第三部分,去到真正后源的服务器设定Varnish 部分,我填了真正后源的IP跟端口跟域名,然后重启 Varnish ,就出现这样了? 这是怎么回事? 谢谢 [Linux] AMH 7.1 https://amh.sh [varnish-6.6 start] ================================================== =========== [OK] varnish-6.6 is already installed. Could not delete 'vcl_boot.1713549650.959259/vgc.sym': No such file or directory Error: Message from VCC-compiler: VCL version declaration missing Update your VCL to Version 4 syntax, and add vcl 4.1; on the first line of the VCL files. ('/home/usrdata/varnish/default.conf' Line 1 Pos 1) ... #--- Running VCC-compiler failed, exited with 2 VCL compilation failedchu10个月前0

很完善的教程‘hu10个月前0

我用gmail EMAIL_SERVER="smtp://********@gmail.com:bpyfv*********[email protected]:587"叽喳10个月前0

MAIL_SERVER="smtp://[email protected]:[email protected]:587" 大佬 这个使用outlook 或者gmail 是什么样子的格式? 邮寄已经开启smtp了hu10个月前0

输入框的问题解决了,我没有设置反代,NEXTAUTH_URL改为域名+端口就好了